Quelle est la différence entre l’imagerie multispectrale vs hyperspectrale ?

La principale différence entre l’imagerie multispectrale et hyperspectrale est le nombre de bandes et l’étroitesse des bandes.

L’imagerie multispectrale fait généralement référence à 3 à 10 bandes. Chaque bande possède un titre descriptif.

Par exemple, les canaux ci-dessous comprennent le rouge, le vert, le bleu, le proche infrarouge et l’infrarouge à ondes courtes.

L’imagerie hyperspectrale se compose de bandes beaucoup plus étroites (10-20 nm). Une image hyperspectrale pourrait avoir des centaines ou des milliers de bandes. En général, elles n’ont pas de noms de canaux descriptifs.

- Multispectral : 3 à 10 bandes plus larges.

- Hyperspectrale : Des centaines de bandes étroites.

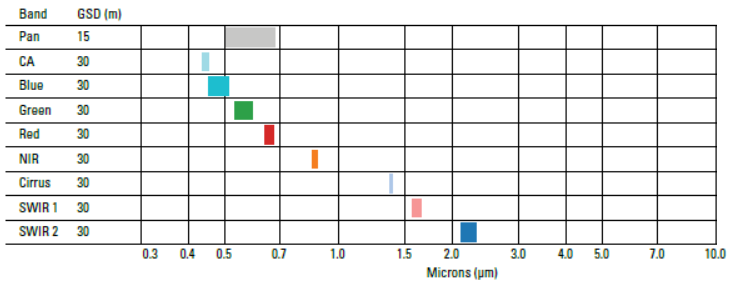

Exemple d’imagerie multispectrale

Un exemple de capteur multispectral est Landsat-8. Par exemple, Landsat-8 produit 11 images avec les bandes suivantes :

- AÉROSOL CÔTIÈRE en bande 1 (0,43-0,45 um)

- BLEU en bande 2 (0,45-0,51 um)

- VERT en bande 3 (0.53-0,59 um)

- ROUGE dans la bande 4 (0,64-0,67 um)

- INFRAROUGE PROCHE (NIR) dans la bande 5 (0,85-0,88 um)

- INFRAROUGE A COURT TERME (SWIR 1) dans la bande 6 (1,57-1.65 um)

- SHORT-WAVE INFRARED (SWIR 2) dans la bande 7 (2.11-2.29 um)

- PANCHROMATIQUE dans la bande 8 (0.50-0.68 um)

- CIRRUS dans la bande 9 (1.36-1.38 um)

- THERMAL INFRARED (TIRS 1) dans la bande 10 (10.60-11,19 um)

- INFRARÉ THERMIQUE (TIRS 2) dans la bande 11 (11,50-12,51 um)

Chaque bande a une résolution spatiale de 30 mètres, sauf pour les bandes 8, 10 et 11. Alors que la bande 8 a une résolution spatiale de 15 mètres, les bandes 10 et 11 ont une taille de pixel de 100 mètres. Comme l’atmosphère absorbe les lumières dans ces longueurs d’onde, il n’y a pas de bande dans la gamme 0,88-1,36.

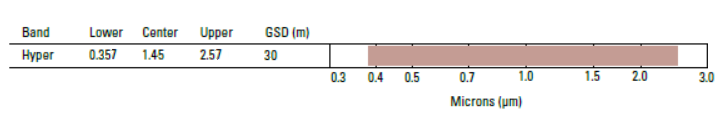

Exemple d’imagerie hyperspectrale

En 1994, la NASA a planifié le premier satellite hyperspectral appelé TRW Lewis. Malheureusement, la NASA a perdu le contact avec lui peu de temps après son lancement.

Mais plus tard, la NASA a eu une mission de lancement réussie. En 2000, la NASA a lancé le satellite EO-1 qui transportait le capteur hyperspectral « Hyperion ». En fait, le spectromètre imageur Hyperion (faisant partie du satellite EO-1) a été le premier capteur hyperspectral de l’espace.

Hyperion produit des images de 30 mètres de résolution dans 242 bandes spectrales (0,4-2,5 um). Si vous voulez tester l’imagerie Hyperion par vous-même, vous pouvez télécharger les données gratuitement sur le site USGS Earth Explorer.

Hyperion a vraiment donné le coup d’envoi de l’imagerie hyperspectrale depuis l’espace. Par exemple, d’autres missions d’imagerie hyperspectrale depuis l’espace comprennent :

- PROBA-1 (ESA) en 2001

- PRISMA (Italie) en 2019

- EnMap (Allemagne) en 2020

- HISUI (Japon) en 2020

- HyspIRI (États-Unis) en 2024

Intuition pour l’imagerie multispectrale et hyperspectrale

Lorsque vous lisez ce post, vos yeux voient l’énergie réfléchie. Mais un ordinateur la voit en trois canaux : rouge, vert et bleu.

- Si vous étiez un poisson rouge, vous verriez la lumière différemment. Un poisson rouge peut voir le rayonnement infrarouge qui est invisible pour l’œil humain.

- Les bourdons peuvent voir la lumière ultraviolette. Encore une fois, les humains ne peuvent pas voir les rayons ultraviolets de nos yeux mais les UV-B nous font du mal.

Maintenant, imaginez si nous pouvions voir le monde avec les yeux d’un humain, d’un poisson rouge et d’un bourdon ? En fait, nous le pouvons. Nous le faisons avec des capteurs multispectraux et hyperspectraux.

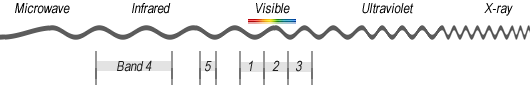

Le spectre électromagnétique

Le visible (rouge, vert et bleu), l’infrarouge et l’ultraviolet sont des régions descriptives du spectre électromagnétique. Nous, les humains, avons créé ces régions dans notre propre but – pour les classer de manière pratique. Chaque région est classée en fonction de sa fréquence (v).

- Les humains voient la lumière visible (380 nm à 700 nm)

- Et les poissons rouges voient l’infrarouge (700 nm à 1mm)

- Les bourdons voient l’ultraviolet (10 nm à 380 nm)

L’imagerie multispectrale et hyperspectrale donne le pouvoir de voir comme les humains (rouge, vert et bleu), les poissons rouges (infrarouge) et les bourdons (ultraviolet). En fait, nous pouvons voir encore plus que cela en tant que rayonnement EM réfléchi vers le capteur.

Multispectral vs Hyperspectral

Avoir un niveau plus élevé de détails spectraux dans les images hyperspectrales donne une meilleure capacité à voir l’invisible. Par exemple, la télédétection hyperspectrale a permis de distinguer 3 minéraux grâce à sa haute résolution spectrale. Mais le Landsat Thematic Mapper multispectral ne pouvait pas distinguer les 3 minéraux.

Mais l’un des inconvénients est que cela ajoute un niveau de complexité. Si vous avez 200 bandes étroites avec lesquelles travailler, comment pouvez-vous réduire la redondance entre les canaux ?

Les images hyperspectrales et multispectrales ont de nombreuses applications dans le monde réel. Par exemple, nous utilisons l’imagerie hyperspectrale pour cartographier les espèces envahissantes et aider à l’exploration minière.

Il existe des centaines d’autres applications où le multispectral et l’hyperspectral nous permettent de comprendre le monde. Par exemple, nous l’utilisons dans les domaines de l’agriculture, de l’écologie, du pétrole et du gaz, des études atmosphériques, et plus encore.

.